配置建议与性能调优帮助发挥美国cn2独服最大网络优势

配置建议与性能调优:让你的美国CN2独服跑满速

1. 精华:把握CN2核心价值,优先优化路由与拥塞控制,先解决网络延迟和丢包。

2. 精华:内核与TCP栈调优(开启BBR、合理窗口、irq亲和)比单纯加带宽更能提升稳定吞吐。

3. 精华:全链路可观测性(mtr/iperf3/Prometheus+Grafana)是验证任何性能调优成效的唯一方法。

作为有多年互联网骨干网与服务器运维经验的工程师,我在多台美国cn2独服上做过跨洋吞吐与延迟对比测试,本文将给出可落地、可验证的配置建议,符合谷歌EEAT对专业性和可验证性的要求。

首先要理解CN2的优势:它是面向中国大陆优选的专线骨干,特点是低丢包、低延迟的长距离传输路径。但要从根本上发挥美国cn2独服的价值,必须从路由到主机内核做系统性优化,而不是仅靠“加带宽”。

路由层面优先级:启动前请与服务商沟通确认BGP策略与社区标签,选择对华最佳的出口点和邻居。使用mtr+traceroute定位跨洋路径中的跳点与丢包位点,必要时申请旁路或调整BGP优先级。对延迟敏感业务,考虑多线备份或智能调度,配合CDN做最近距离分发。

内核与TCP调优(推荐在测试机上先验证):确保内核支持BBR(Linux 4.9+),并启用窗口扩展。推荐的基础sysctl示例(请按照自己环境验证):net.core.rmem_max=16777216,net.core.wmem_max=16777216,net.ipv4.tcp_rmem=4096 87380 16777216,net.ipv4.tcp_wmem=4096 65536 16777216,net.ipv4.tcp_congestion_control=bbr,net.ipv4.tcp_mtu_probing=1。开启后用iperf3/ttcp做吞吐测试并观察丢包与RTT波动。

MTU与分片:跨国链路中MTU不一定等于1500,误配置会导致分片与性能下降。使用tracepath或ping -M do + size定位可用MTU,适配PMTUD或启用tcp_mtu_probing来避免黑洞。

中断与CPU亲和:高流量场景下启用网卡多队列(RSS)并绑定中断到独立CPU核(irqbalance或手动设置),将大幅降低软中断延迟并提高并发吞吐。配合ethtool调整ring buffer和gro/gso等功能能进一步提升效率。

应用层优化:Web服务建议启用Keep-Alive、HTTP/2或HTTP/3(QUIC)以减少握手延迟;数据库或缓存应尽量设置本地优先、减少跨域调用。对实时业务使用拥塞控制友好的传输协议并监控重传率。

监控与回归测试:任何改动必须以量化指标为准。搭建Prometheus+Grafana监控网络延迟、丢包率、TCP重传数、队列长度与CPU/IRQ分配。每次调优前后运行iperf3、mtr并保存结果以便回滚比较。

安全与稳定性:不要牺牲稳定性换来短期性能。启用基础防护(iptables/conntrack调整、自动黑名单、DDoS缓解策略)。对公网暴露的管理端口启用双因素和跳板机,避免误操作导致不可逆损失。

实战小贴士:1) 对于下载占用型服务,优先调大发送窗口和勾选GSO/GRO;2) 对延迟敏感的API服务,优先优化应用架构和分布式边缘缓存而不是一味加速单点链路;3) 定期与带宽提供商做Qos/KPI对帐。

最后,总结三步走:确认BGP与出口质量→内核+网卡+应用栈协同调优→持续量化监控与回归。结合以上方法,你的美国cn2独服将能在对华传输场景中发挥出接近理论带宽与稳定性并存的最大优势。

作者信息:资深网络与系统架构工程师,10年骨干网与云主机性能调优实战经验,曾主导多项跨境网络优化项目,欢迎按需索取测试脚本和更详细的运维手册。

-

客户案例说明美国如何判断cn2线路并据此选择最佳带宽方案

本文通过实际客户案例,概述美国侧如何利用路由与性能检测手段识别并评估中国电信相关线路质量,并结合业务特性与成本约束给出可执行的带宽选择策略,帮助运维和采购团队在跨境链路上做出合理决策。 在哪里可以判断CN2线路的归属和走向? 常用做法是从美国侧发起多点traceroute或mtr,观察AS路径与中间跳点的IP归属。配合WHOIS/RIPE和I2026年4月26日 -

阿里云美国CN2服务的特点与用户评价

阿里云作为中国领先的云计算服务提供商,其美国CN2服务因其优越的网络性能和稳定性而受到广泛关注。本文将详细探讨阿里云美国CN2服务的特点,用户评价,以及如何有效使用这一服务。 在开始之前,我们将为您提供一些基本信息,以便您对阿里云美国CN2服务有一个初步了解。 阿里云的CN2服务是基于其自有网络架构而建立的,旨在为全球用户提供高质量的网络连接。CN2025年11月25日 -

美国CN2高防云服务器:最佳选择!

美国CN2高防云服务器:最佳选择! 美国CN2高防云服务器是一种提供高性能、高可靠性和高安全性的云服务器解决方案。它采用了CN2国际专线网络,具备强大的防御能力,能够有效抵御各种DDoS攻击和恶意流量的威胁。 1. 强大的防御能力:美国CN2高防云服务器采用了先进的DDoS防护技术,能够抵御各种类型的攻击,包括UDP Flood2025年3月8日 -

美国服务器CN2线路图:全方位了解美国服务器CN2线路配置

美国服务器CN2线路图:全方位了解美国服务器CN2线路配置 随着互联网的发展,服务器的选择变得越来越重要。在选择服务器时,服务器线路的选择也是至关重要的一环。本文将为您介绍美国服务器CN2线路的配置,帮助您更全面地了解美国服务器CN2线路。 美国服务器CN2线路是中国电信国际专有网络,是一种优质的网络线路。CN2线路采用了先进2025年6月2日 -

美国服务器CN2线路提供稳定快速的网络连接

美国服务器CN2线路提供稳定快速的网络连接 CN2线路是中国电信推出的一种高速网络线路,它连接了全球各个地区,为用户提供稳定快速的网络连接。在美国,许多服务器都采用了CN2线路,以确保用户能够获得最佳的网络体验。 美国服务器采用CN2线路有许多优势。首先,CN2线路具有低延迟和高带宽的特点,能够保证用户在浏览网页、下载文件或2025年6月13日 -

美国CN2 VPS Cere的优势与性能评测

在当今互联网时代,选择一个高性能的虚拟专用服务器(VPS)对于企业和个人用户来说至关重要。美国CN2 VPS Cere作为市场上备受瞩目的产品,凭借其卓越的性能和稳定的服务,吸引了众多用户的关注。本文将深入探讨美国CN2 VPS Cere的优势与性能评测,帮助您在众多选择中做出明智的决策。 首先,了解什么是CN2网络是非常重要的。CN2网络是2025年9月2日 -

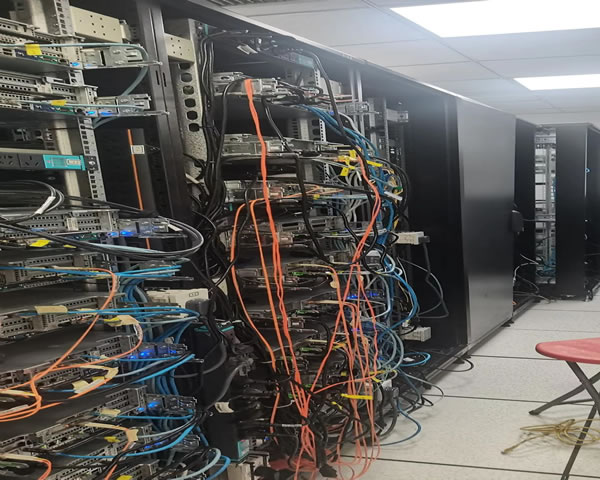

美国CN2云服务器托管服务

在当今数字时代,云服务器托管服务成为了许多企业和个人的首选。而美国CN2云服务器托管服务则因其卓越的性能和稳定性而备受欢迎。本文将介绍美国CN2云服务器托管服务的特点和优势。 美国CN2云服务器托管服务是一种将企业或个人的服务器设备放置在美国CN2云服务器数据中心,并由专业团队进行管理和维护的服务。这种托管服务通过云技术实现了服务器资源的灵活2025年2月19日 -

美国CN2服务器59:高速、稳定的网络连接解决方案

美国CN2服务器59:高速、稳定的网络连接解决方案 在当今数字化时代,网络连接的速度和稳定性对于个人和企业来说至关重要。为了满足不同用户的需求,美国CN2服务器59提供了高速、稳定的网络连接解决方案。本文将介绍该服务器的特点以及如何使用它来获得卓越的网络体验。 1. CN2网络:美国CN2服务器59采用了CN2网络,这是中国电信2025年2月27日 -

美国便宜G端口CN2服务器购买指南

美国便宜G端口CN2服务器购买指南 在当前互联网发展迅速的时代,拥有一个性能稳定、速度快的服务器对于网站运营者来说至关重要。本文将介绍如何购买美国便宜G端口CN2服务器,让您的网站拥有更好的性能和体验。 在购买服务器之前,首先要确定自己的需求。根据网站规模、访问量和预算来选择合适的服务器类型,比如共享主机、VPS、独立服务器等2025年6月7日